ThInfo

Théorie de l’information

Description : Dans ce cours les élèves devront acquérir et maîtriser les bases de la théorie de l’information. Les notions suivantes seront abordées : problème de codage source, entropie d’un echantillon et d’une distribution de probabilité, entropie conjointe et conditionelle, information mutuelle et divergence de Kullback-Leibler, et principe de maximum d’entropie. L’utilisation d’arbre à prefixe pour determiner des codages uniquement décodable est abordée par l’exemple du codage optimal de Huffman.

Acquis d’apprentissage : À l’issue de ce cours, les élèves seront capables de décrire et expliquer les concepts fondamentaux du codage de sources ainsi que les problématiques associées, de presenter une intuition des implications des concepts du cours pour le problème du codage source, de manipuler et analyser l’entropie d’un point de vue mathématique, de définir la divergence de Kullback–Leibler et l’articuler avec les notions d’entropie et d’information mutuelle et de mettre en œuvre le principe du maximum d’entropie

Modalités d’évaluation : Examen écrit 2h, rattrapable

Responsable de cours : Paul Fraux

Identifiant Geode : SPM-MAT-007

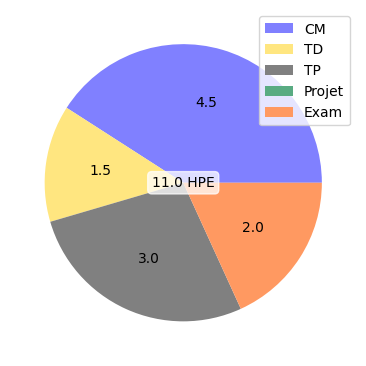

CM :

- Codage source de canaux discrets (1.5 h)

- Théorie de l’information 1/2 (1.5 h)

- Théorie de l’information 2/2 (1.5 h)

TD :

- Entropie et divergence KL (1.5 h)

TP :

- Codage de Huffman (3.0 h)